盘古大模型被指抄袭?华为回应后,又有员工爆料

- 2025-07-08 11:19:53

华为研发团队于7月5日发布声明,坚决否认抄袭指控,强调模型基于昇腾硬件平台独立开发,并严格遵循开源协议。

然而,就在7月6日凌晨,一位自称是盘古大模型团队的员工再次自曝,确实存在套壳、续训、洗水印的现象。

争议起源:参数相关性超行业阈值

6月30日,华为宣布开源盘古7B稠密模型、盘古Pro MoE 72B混合专家模型及基于昇腾的推理技术。相关阅读:《华为开源盘古7B稠密与72B混合专家模型》

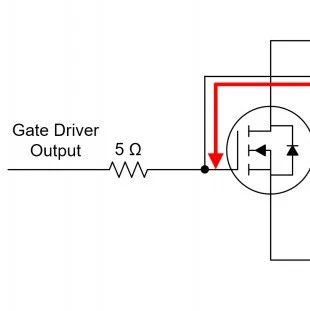

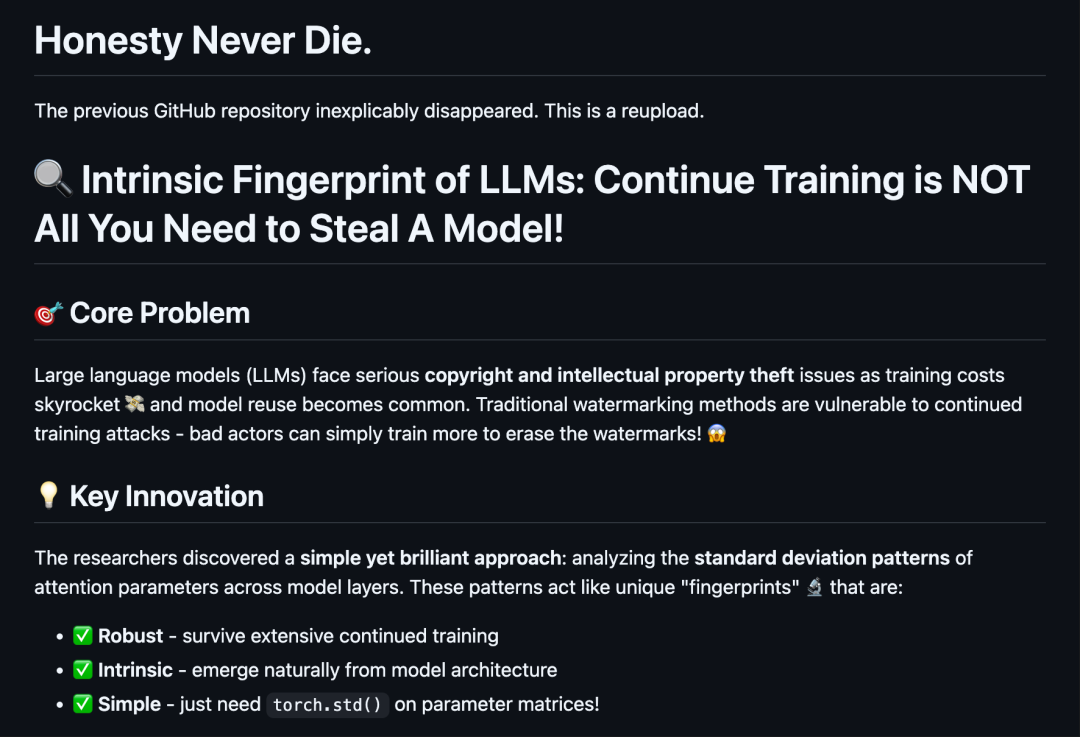

随后,GitHub用户@HonestAGI发布研究称,通过模型指纹技术(参数标准差组合)比对,发现盘古Pro MoE与Qwen-2.5 14B在注意力参数分布上的平均相关性达0.927(接近完全一致),远超业内正常范围(通常≤0.7)。该研究认为,这种高度相似性“自然发生的概率极低”,暗示盘古可能基于Qwen代码增量训练。

另有研究者指出,盘古大模型与通义千问模型在多个技术细节上存在高度相似性,例如QKV偏置分析揭示盘古和Qwen2.5-14B在所有三种投影类型(Q、K、V)上都存在惊人相似性,两种模型展现出几乎相同的模式,尤其是早期层特有的尖峰特征及随后的收敛行为。此外,注意力层归一化权重分析进一步强化了相似性,盘古和Qwen2.5-14B在层序列上展现出极为一致的趋势,具有平行的初始化模式和收敛行为。

盘古模型中出现通义千问代码

争议迅速发酵。@HonestAGI进一步指出,盘古开源代码中出现“Copyright 2024 The Qwen team, Alibaba Group”的版权声明,被部分网友视为“实锤”。

此外,有观点认为,华为在开源代码仓库中未完全披露部分代码的来源,导致外界质疑其是否存在“借鉴”行为。然而,该研究随后下架,且未公开完整测试代码,其方法科学性遭质疑。

华为回应:独立开发与创新架构,开源合规性受认可

7月5日下午,华为诺亚方舟实验室发布官方声明,逐条回应争议:

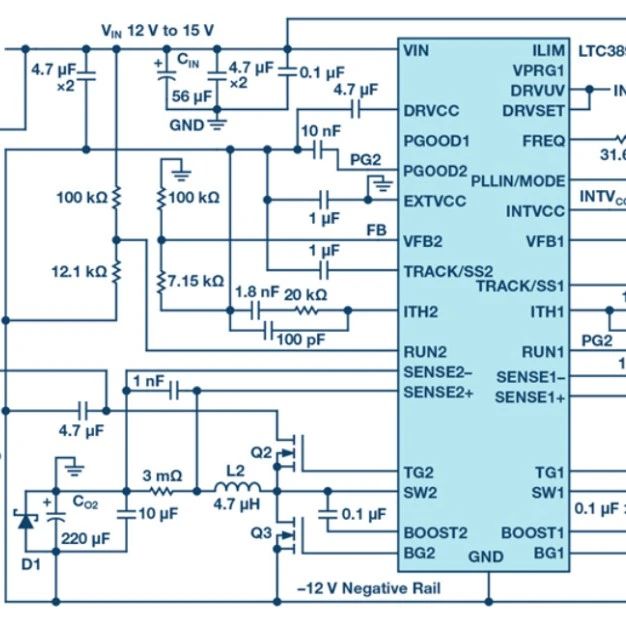

1.独立开发性:盘古Pro MoE基于昇腾300I Duo/800I A2硬件平台开发,非基于其他厂商模型增量训练,在架构设计、技术特性上实现关键创新,包括全球首个面向昇腾平台的分组混合专家(MoGE)架构,有效解决分布式训练负载均衡难题。

2.开源合规性:部分基础组件代码参考业界开源实践,涉及其他开源大模型代码,但严格遵循Apache License 2.0等开源协议要求,在代码文件中清晰标注版权声明。例如,使用的“transformers”组件由Qwen团队与HuggingFace联合开发,属合规引用。

3.硬件差异:盘古模型训练基于昇腾芯片,与Qwen使用的训练硬件平台不同,进一步佐证独立开发。

声明进一步指出,华为始终尊重第三方知识产权,并提倡“开放、包容、公平、团结和可持续的开源理念”。团队重申,盘古Pro MoE模型的核心算法、训练框架及硬件适配均为自主开发,与通义千问无直接关联。

诺亚方舟实验室负责人王云鹤在内网补充回应:“盘古大模型并非从零起步,但使用的Llama和Qwen组件均为开源,不存在抄袭。”

实测数据显示,盘古 Pro MoE 在昇腾 800I A2 平台上实现 1528 tokens/s 的推理吞吐,较通义千问在阿里云 GPU 集群上的性能高出约 30%。这种差异源于华为对昇腾芯片的 DNNCPU 计算单元、HCCL 通信库的深度优化,而通义千问的性能优势则体现在阿里云的分布式调度系统。

参数相似性或源于开源组件复用

技术专家指出,盘古与Qwen的参数相关性可能源于以下原因:

·开源组件复用:两者均基于HuggingFace的“transformers”库开发,该库为行业通用组件,可能导致部分参数结构趋同。

·测试方法局限性:@HonestAGI采用的参数标准差比较法未被广泛认可。例如,Baichuan2-13B与Qwen-1.5 14B的对比也显示较高相似性(0.87),说明该方法可能无法准确衡量模型原创性。

·硬件适配影响:盘古深度绑定昇腾芯片的架构优化,可能间接影响参数分布,但与Qwen的通用硬件路径存在本质差异。

而且独立技术分析显示,MoE 架构作为当前大模型主流技术路线,其核心设计思路存在行业共性。例如,谷歌 Switch Transformer、英伟达 Megatron 等开源模型均采用类似的专家分组路由机制,参数配置也存在标准化设计模式。

新浪财经报道称,目前尚无确凿证据证明盘古抄袭,争议核心在于“开源协作边界”的界定。华为盘古代码中虽包含Qwen版权声明,但属开源协议要求的合规标注,与抄袭无直接关联。

查阅盘古 Pro MoE 在 GitCode 平台的开源代码库可见,其核心文件均包含完整的版权声明。例如,在 MoE 路由模块的代码注释中明确标注:"This implementation references the open-source project from [Third-party Repository], licensed under MIT License." 这种将开源引用显性化的做法,符合 OSI(开源倡议组织)的合规要求。

内部员工再次爆料

7月6日,在华为发表声明后,一封疑似盘古大模型团队内部员工的公开信在网络上流传。

该员工在信中自曝称,盘古大模型存在套壳、续训、洗水印等行为,并详细介绍了内部的组织架构和工作流程,以及一些模型开发过程中的细节。该员工表示,这些行为可能会成为自己“一生都无法抹除的污点”,因此选择自曝并离职,同时申请从盘古部分技术报告的作者名单中移除。

网传华为诺亚方舟实验室员工爆料长文截图,全文截图在文末

该员工表示,由于团队初期算力非常有限,虽做出了很多努力和挣扎,但没有预期效果,内部的质疑声和领导的压力也越来越大。后来小模型实验室多次套壳竞品,领导层被指默许造假行为换取短期成果。

自曝文中称:“经过内部的分析,他们实际上是使用Qwen 1.5 110B续训而来,通过加层,扩增ffn维度,添加盘古pi论文的一些机制得来,凑够了大概135B的参数。”并表示,“听同事说他们为了洗掉千问的水印,采取了不少办法,甚至包括故意训了脏数据。”“他们选择了套壳DeepSeekv3续训。他们通过冻住DeepSeek加载的参数,进行训练。”

截至目前,华为并未对此自曝内容发表声明。

开源生态规则模糊性待厘清

此次事件暴露AI大模型开源生态的三大痛点:

1.开源定义模糊:如何区分“合理引用”与“抄袭”,缺乏行业统一标准。例如,使用开源组件进行二次开发是否需额外授权,仍存争议。

2.测试方法规范性:模型相似性评估缺乏权威工具,导致争议难以快速平息。

3.知识产权保护:大模型可通过专利、商标、版权等多维度保护,但开源项目需平衡“开放”与“权益保障”。

开源社区的核心是共享与协作,但开发者必须明确区分“参考”与“复制”的界限。华为的声明中提到代码标注特别指出,这种做法是开源社区的通行规则,例如 Meta Llama 2、字节跳动 Doubao 等开源模型均采用类似的合规处理方式。但是若属实则符合开源规范,但最终仍需通过技术审计验证。

同时,有观点认为,AI大模型的参数设计、训练方法等存在一定共性,企业间的技术趋同未必构成抄袭。例如,MoE架构作为主流技术路线,已被多家厂商采用,包括谷歌、微软等国际巨头。但若涉及特定代码片段的直接使用,则可能触及法律风险。

据《财经》报道,多家科技企业已关注此事进展,未来或推动建立更清晰的开源协议细则。华为云数据显示,盘古大模型已在30余个行业、400余个场景落地,此次争议或加速行业对开源协作规范的重视。

阿里未正式回应,市场静待技术对决

截至7月7日,阿里巴巴通义千问团队未对抄袭指控发表官方声明。但据《观察者网》报道,阿里内部正关注此事进展,或通过技术论文或法律途径维护权益。

有业内人士指出,阿里通义千问自2023年发布以来,已多次通过技术论文和开源代码展示其研发过程,且其模型参数和架构设计均基于公开技术路径。阿里巴巴开源技术委员会成员也曾公开表示:"通义千问开源版本遵循宽松的 Apache 2.0 协议,允许商业使用和二次开发,只要保留版权声明即可。"

业内认为,最终争议需通过第三方权威机构对盘古与Qwen的代码、训练数据进行全面审计方可定论。在此之前,华为需进一步公开技术细节以自证清白,而开源社区亦需完善协作规则,避免类似争议重演。

附网传华为诺亚方舟实验室员工爆料长文截图(全):

END

扫码添加微信

扫码添加微信

- 点赞 (0)

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊