CVPR冠军方案BridgeVLA | 真机性能提升32%,3D VLA新范式!

- 2025-07-31 07:00:00

击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

3D视觉工坊很荣幸邀请到了中科院自动化所在读博士李沛言,为大家着重分享他们团队的工作:BridgeVLA。如果您有相关工作需要分享,欢迎文末联系我们。

BridgeVLA: Input-Output Alignment for Efficient 3D Manipulation Learning with Vision-Language Models

BridgeVLA: Input-Output Alignment for Efficient 3D Manipulation Learning with Vision-Language Models

论文:https://arxiv.org/pdf/2506.07961

主页:https://bridgevla.github.io/home_page.html

代码:https://github.com/BridgeVLA/BridgeVLA

数据集:https://huggingface.co/datasets/LPY/BridgeVLA/tree/main

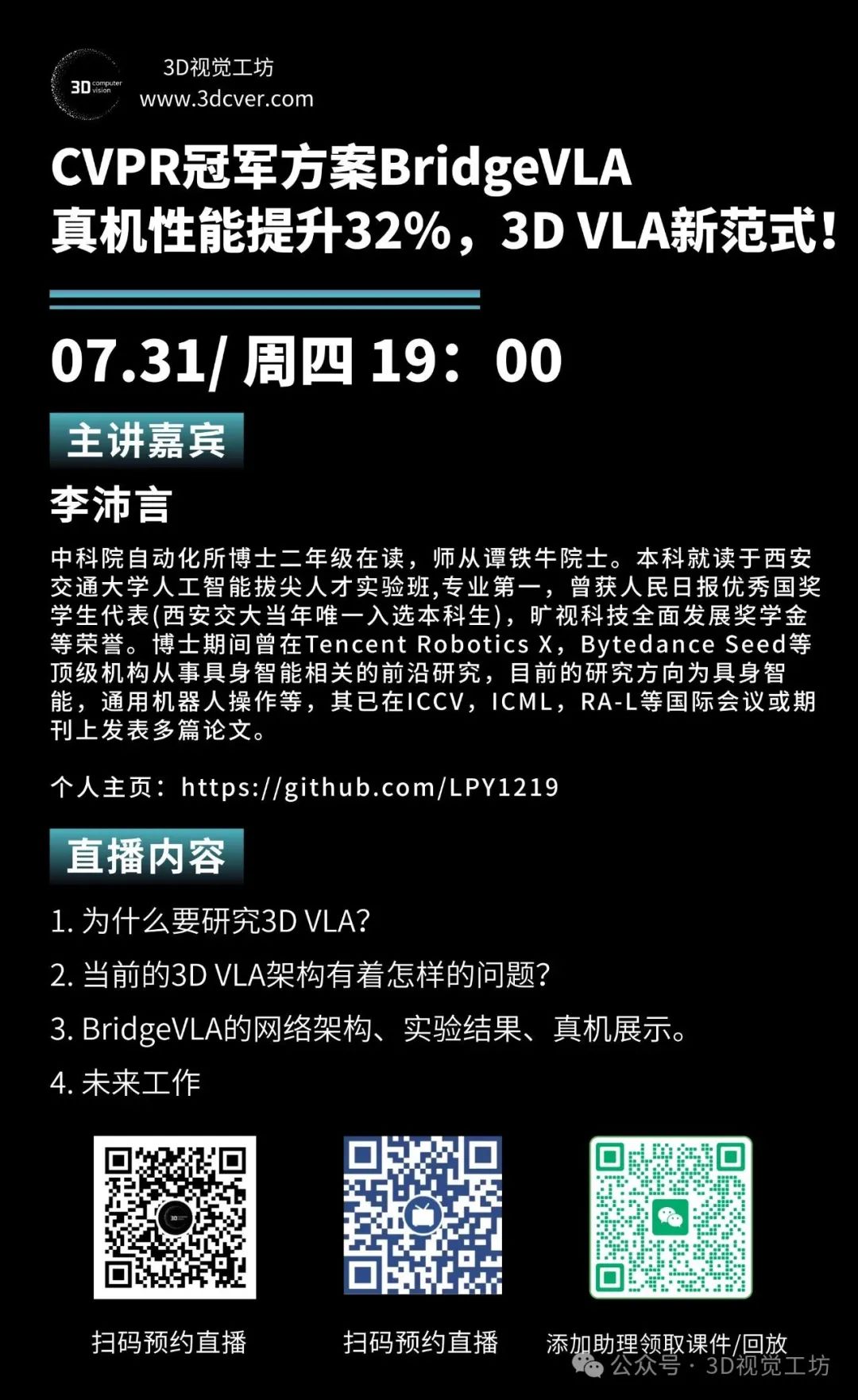

直播信息

时间

2025年07月31日(周四)19:00

主题

CVPR冠军方案BridgeVLA | 真机性能提升32%,3D VLA新范式!

直播平台

3D视觉工坊哔哩哔哩

扫码观看直播,或前往B站搜索3D视觉工坊观看直播

3D视觉工坊视频号也将同步直播

主讲嘉宾

李沛言

李沛言

中科院自动化所博士二年级在读

中科院自动化所博士二年级在读,师从谭铁牛院士。本科就读于西安交通大学人工智能拔尖人才实验班,专业第一,曾获人民日报优秀国奖学生代表(西安交大当年唯一入选本科生),旷视科技全面发展奖学金等荣誉。博士期间曾在Tencent Robotics X,Bytedance Seed等顶级机构从事具身智能相关的前沿研究,目前的研究方向为具身智能,通用机器人操作等,其已在ICCV,ICML,RA-L等国际会议或期刊上发表多篇论文。

个人主页: https://github.com/LPY1219

直播大纲

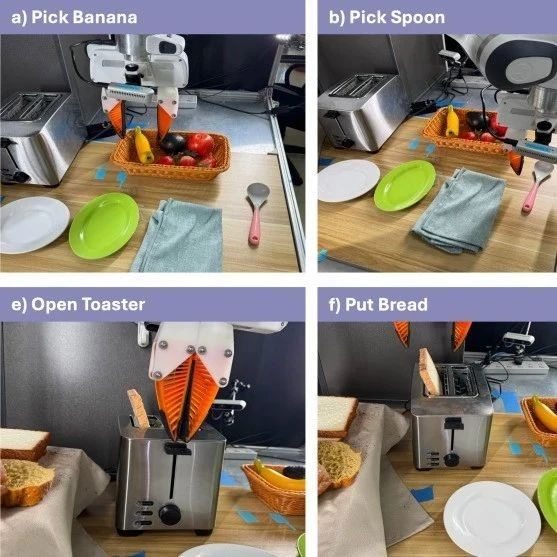

2D VLA泛化性很好,但动辄却要上百条数据;3D Manipulation Policy仅需10条轨迹就可以work,但却很难泛化到未见过的场景。所以,是否能设计一个结合二者优点的3D VLA,同时做到efficient和effective?事实上,如果只是简单地复用VLM的预训练权重,并不能构造出我们期待的3D VLA模型。根本原因在于VLM的输入输出和所需的3D VLA的输入输出之间存在着巨大Gap,导致我们无法将VLM的潜力充分发挥出来,而BridgeVLA的提出就是为了Bridge the gap。

为什么要研究3D VLA? 当前的3D VLA架构有着怎样的问题? BridgeVLA的网络架构、实验结果、真机展示。 未来工作

参与方式

注:3D视觉工坊很荣幸邀请到了中科院自动化所在读博士李沛言,为大家着重分享他们团队的工作:BridgeVLA。如果您有相关工作需要分享,欢迎联系微信:cv3d009 请备注:宣传工作,则不予通过。

扫码添加微信

扫码添加微信

- 点赞 (0)

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊