谷歌研究院联合加州大学等发布AVLMaps:多模态空间语言地图赋能机器人零样本导航与跨模态推理

- 2025-07-16 20:35:56

摘要

Abstract

AVLMaps提出多模态空间语言地图,融合音频、视觉、语言线索于3D体素网格,支持零样本导航。

项目地址:https://mslmaps.github.io

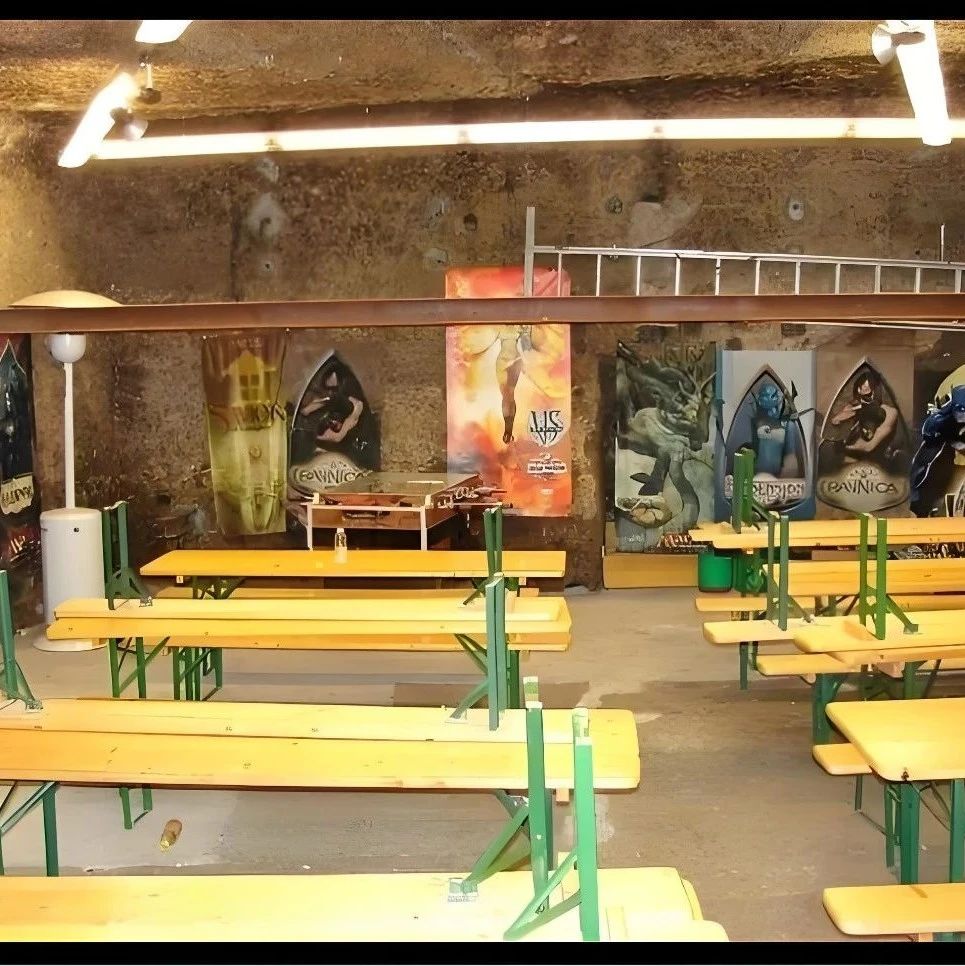

AVLMaps 使用来自音频、视觉和语言的多模态提示来解决现实世界中的零镜头空间导航任务。

将语言接地到导航代理的观察可以利用预先训练的多模态基础模型将感知与对象或事件描述相匹配。然而,以前的方法仍然与环境映射脱节,缺乏几何映射的空间精度,或者忽略了视觉之外的其他模态信息。

为了解决这个问题,我们提出了多模态空间语言映射作为空间映射表示,它将预训练的多模态特征与环境的 3D 重建融合在一起。

我们使用标准探索自主构建这些地图。我们展示了地图的两个实例,它们是视觉语言地图 (VLMap) 和它们对通过添加音频信息获得的视听语言地图 (AVLMap) 的扩展。当与大型语言模型 (LLM) 结合使用时,VLMap 可以:

(1) 将自然语言命令转换为直接定位在地图中的开放词汇空间目标(例如,“在沙发和电视之间”);

(2) 在不同的机器人实施例之间共享,以按需生成定制的障碍地图。

在上述功能的基础上,AVLMaps 通过融合预训练多模态基础模型的功能,引入集成的统一 3D 空间表示,集成音频、视频和语言线索,从而扩展了 VLMaps。这使机器人能够将多模态目标查询(例如,文本、图像或音频片段)接地到空间位置以进行导航。此外,在模棱两可的环境中,不同感官输入的结合显着增强了目标歧义消除。

模拟和真实环境中的实验表明,我们的多模态空间语言地图可实现零镜头空间和多模态目标导航,并在模棱两可的场景中将召回率提高 50%。 这些功能扩展到移动机器人和桌面机械手,支持由视觉、音频和空间线索引导的导航和交互。

方法

创建

构建 AVLMap 的关键思想是将视觉和音频信息集成到环境的 3D 重建中。这可以通过计算视觉定位特征(例如 NetVLAD、SuperPoint)、视觉语言特征(例如 LSeg)和音频语言特征(例如 AudioCLIP)来完成,并将这些特征与 3D 重建相关联。最后,我们可以预测 3D 热图,指示多模态概念(如对象、声音和图像)的位置。

跨模态推理

当语言不明确时,机器人可以使用多模态信息来缩小目标位置的范围。例如,如果要求机器人走到“婴儿哭声附近的椅子上”,它就可以利用地图中集成的音频信息来消除目标的歧义。这背后的直觉是,我们将来自不同模态的预测转换为 3D 热图,并计算热图的像素级联合概率。这允许我们计算给定多模态查询的目标位置的概率。

多模式空间目标导航

我们在大型语言模型的帮助下以可执行代码的形式生成导航策略。通过在提示中提供一些示例,我们利用 GPT-3 将语言指令解析为一串可执行代码,表达函数或逻辑结构(if/else 语句、for/while 循环)并参数化 API 调用(例如,robot.load_image(img_path)、robot.move_to(位置)、robot.get_major_map(sound=sound_name)、robot.get_major_map(img=image)、robot.get_major_map(obj=obj_name) 等)。

来自语言的多模态空间目标导航

桌面跨模态目标推理

我们扩展了我们的研究,以评估 AVLMaps 如何在实际桌面任务中使基于固定的机械手受益,这需要对场景进行更详细的语义理解。在这种设置中,机器人机械手必须以更严格的误差容忍度(10 厘米以内)接近多模态目标。此外,我们还探讨了 AVLMaps 在具有不同实施例的机器人中的应用潜力。

往期文章

具身专栏(三)| 具身智能中VLA、VLN、VA中常见训练(training)方法

具身专栏(二)| 具身智能中VLA、VLN分类与发展线梳理

具身专栏(一)| VLA、VA、VLN概述

π0.5:突破视觉语言模型边界,首个实现开放世界泛化的VLA诞生!

斯坦福&英伟达最新论文:CoT-VLA模型凭"视觉思维链"实现复杂任务精准操控

RoboTwin2.0全面开源!多模态大模型驱动的双臂操作Benchmark ,支持代码生成!

开源!Maniskill仿真器上LeRobot的sim2real的RL训练代码开源(附教程)

迈向机器人领域ImageNet,大牛PieterAbbeel领衔北大、通院、斯坦福发布RoboVerse大一统仿真平台

CVPR 北大、清华最新突破:机器人操作新范式,3.3万次仿真模拟构建最大灵巧手数据集

人形机器人四级分类:你的人形机器人到Level 4了吗?(附L1-L4技术全景图)建议收藏!

斯坦福最新论文:使用人类动作的视频数据,摆脱对机器人硬件的需求

爆发在即!养老机器人如何守护2.2亿老人?产业链+政策一览,建议收藏!

扫码添加微信

扫码添加微信

- 点赞 0

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊