只打高端局的多模态融合,用可解释性再次霸榜CVPR!

- 2025-07-15 18:27:00

有人问可解释的多模态融合到底是不是坑?答曰:卷,但机会犹存。根据CVPR 2025投稿数据,多模态+可解释是三大热门之一,而工业界也同样渴求可解释性...因此这方向可以说需求爆炸,痛点深重,还是很值得卷一卷的。

不过对于论文er来说,目前纯刷榜的“可解释后处理”已经越来越难中了,必须把可解释性设计进模型底层。也就是说,发文思路推荐:架构创新 > 垂直应用 > 后处理工具。创新点可着力关系推理、具身解释、边缘部署等。

其实说白了,就是找个工业界痛点(如医疗误诊、机器人事故),用可解释性解决它。这边为了方便各位理解,我搜罗了15篇可解释多模态融合前沿paper作参考,帮大家省点时间推进度,毕竟实验室的KPI、顶会的ddl、基金申请都等着呢~

扫码添加小享,回复“可解释多模态”

免费获取全部论文+代码合集

Explainable Multi-modal Time Series Prediction with LLM-in-the-Loop

方法:论文提出TimeXL框架,结合时间序列编码器与三个协同LLM,实现可解释多模态预测。框架处理多模态输入,生成预测与解释,通过LLM优化推理、检测偏差、改进文本并触发重训练,形成闭环。在真实数据集上验证优越性,展现LLM在时间序列预测的潜力。

创新点:

提出 TimeXL 框架,融合多模态数据进行时间序列预测。 采用预测、反思、优化的闭环流程,提升预测准确性和可解释性。 利用 LLM 的推理能力,生成基于案例的解释,增强模型的透明度。

X-driver: Explainable autonomous driving with vision-language models

方法:论文提出 X-Driver 框架,通过多模态大语言模型(MLLMs)和链式思考推理,实现端到端自动驾驶。该框架利用自回归Transformer融合视觉和语言信息,通过逐步推理提升决策的可解释性和鲁棒性,显著优于现有方法。

创新点:

提出X-Driver框架,融合多模态大语言模型(MLLMs)实现端到端自动驾驶。 引入链式思考(CoT)推理机制,提升决策透明度和鲁棒性。 在闭环自动驾驶任务中显著优于现有方法,提供更可靠的决策解释。

扫码添加小享,回复“可解释多模态”

免费获取全部论文+代码合集

Exploring Multi-Modality Dynamics: Insights and Challenges in Multimodal Fusion for Biomedical Tasks

方法:论文研究了多模态融合在生物医学分类任务中的应用,尤其是对 MM Dynamics 方法的复现和扩展。研究进一步将 MM Dynamics 扩展到图像数据,提出了 Image MM Dynamics,虽然定性结果较好,但定量上仍未超越传统方法。

创新点:

分析了多模态动态方法在生物医学分类任务中的表现,发现特征信息量有助于提升模型性能和可解释性。 指出模态信息量未能显著提升性能,甚至可能引入噪声,导致性能下降。 将 MM Dynamics 扩展到图像数据,提出了 Image MM Dynamics,虽然定性结果较好,但定量上仍未超越传统方法。

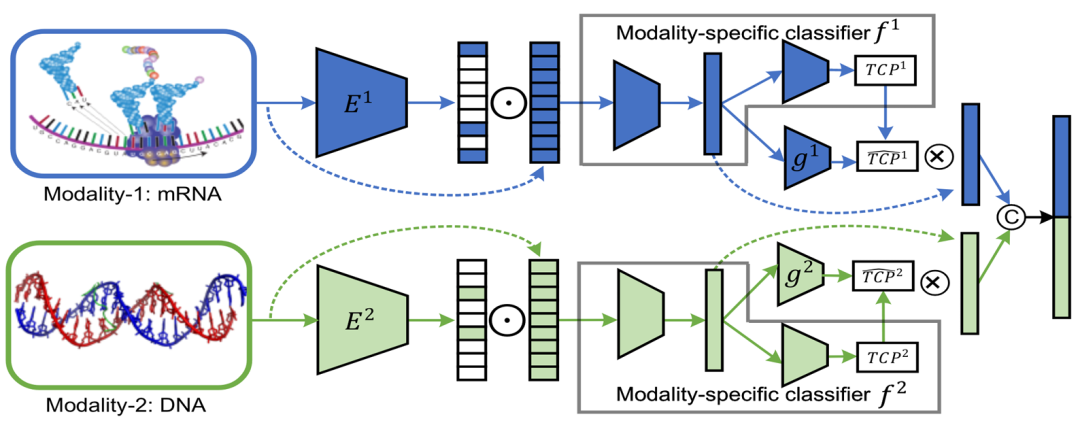

TransMA: an explainable multi-modal deep learning model for predicting properties of ionizable lipid nanoparticles in mRNAdelivery

方法:论文提出了一种名为TransMA的可解释多模态深度学习模型,用于预测可电离脂质纳米颗粒的转染效率。该模型通过融合分子的三维结构特征和一维序列特征,实现了高精度的转染效率预测,并通过注意力机制揭示了关键原子对转染效率的影响。

创新点:

提出 TransMA 模型,融合分子的三维空间特征和一维序列特征,用于预测可电离脂质纳米颗粒的转染效率。 设计 mol-attention 机制块,对齐和融合多模态特征,揭示原子结构与转染效率的关系。 在最大 LNPs 数据集上实现 SOTA 性能,并通过转染悬崖验证模型的可解释性。

扫码添加小享,回复“可解释多模态”

免费获取全部论文+代码合集

扫码添加微信

扫码添加微信

- 点赞 0

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊