上岸双一区TOP!Transformer+时间序列

- 2025-07-12 18:05:00

看到一个讨论:Transformer是否适用于做非NLP领域的时间序列问题?

实际上,因为Transformer的天然结构比较适合时序,工业界已经有不少在做的了,比如有名的TFT。学术界因为这方向比较容易发论文,基于Transformer的时序研究也非常多,当然落地效果也挺好,比如今年双一区TOP刊上的一种用于检测美国陆地表面物候的方法。

如今,这方向的创新已经超越架构改良,正向通用化、多模态融合等更深维度演进。今年的突破将集中于统一框架设计与工业级轻量化部署,争取在能源、交通等领域做到“开箱即用”。

为方便大家了解前沿,本文整理了12篇Transformer+时间序列最新论文,包含开源代码,大家可用作创新点参考。

扫码添加小享,回复“时序融合”

免费获取全部论文+开源代码

A transformer-based model for detecting land surface phenology from the irregular harmonized Landsat and Sentinel-2 time series across the United States

方法:论文提出了一种基于Transformer的深度学习模型,用于从不规则的HLS时间序列数据中检测陆地表面物候。该模型利用注意力机制捕捉长期依赖关系,无需填补时间间隔,直接处理带有缺失值的时间序列,提高了物候事件检测的准确性和效率。

创新点:

利用Transformer模型处理不规则时间序列数据,无需提前填补时间间隔。 使用高质量的HLS-PhenoCam物候产品作为训练数据,提升模型的准确性和可靠性。 在多种生态系统中验证模型,证明其在检测物候事件上的准确性和泛化能力。

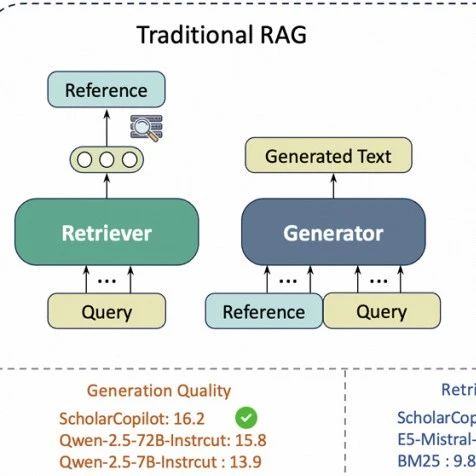

Citras: Covariate-informed transformer for time series forecasting

方法:论文提出CITRAS模型,基于Transformer,用于多目标时间序列预测。它通过KV Shift整合未来协变量,Attention Score Smoothing捕捉全局依赖,在多个数据集上实现最优预测性能。

创新点:

提出CITRAS模型,利用Transformer架构和KV Shift机制整合未来已知协变量,提高预测精度。 引入Attention Score Smoothing技术,将局部依赖平滑为全局依赖,提升模型对时间序列的全局理解。 在协变量预测和多变量预测任务中均取得优异性能,证明了模型的有效性和泛化能力。

扫码添加小享,回复“时序融合”

免费获取全部论文+开源代码

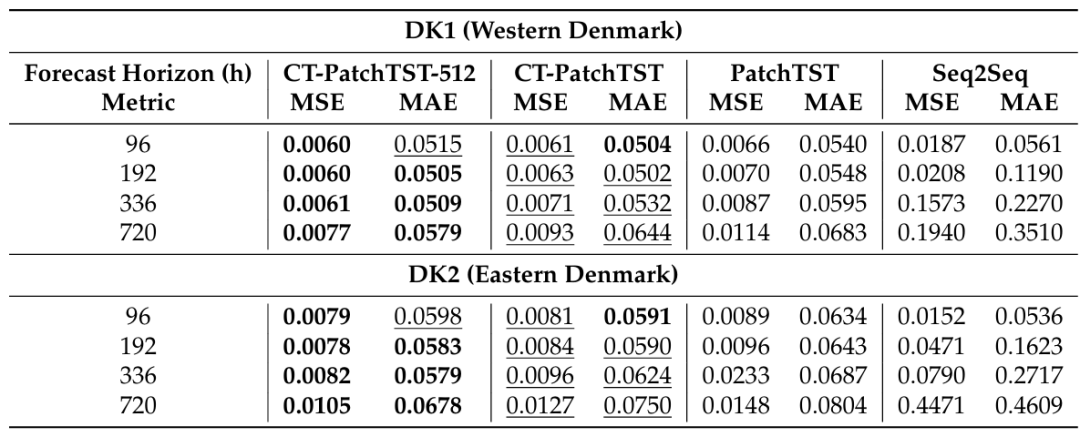

Ct-patchtst: Channel-time patch time-series transformer for long-term renewable energy forecasting

方法:论文提出了一种基于Transformer的时间序列预测模型CT-PatchTST,通过通道注意力和时间注意力机制,同时处理多变量时间序列中的通道间和时间依赖性,显著提高了可再生能源功率预测的准确性。

创新点:

提出通道注意力机制,有效捕捉多变量时间序列中不同通道间的依赖关系。 引入时间注意力机制,独立处理每个通道的时间依赖性,增强模型对时间序列的建模能力。 结合通道和时间双重注意力机制,显著提升模型在复杂多变量时间序列预测中的性能。

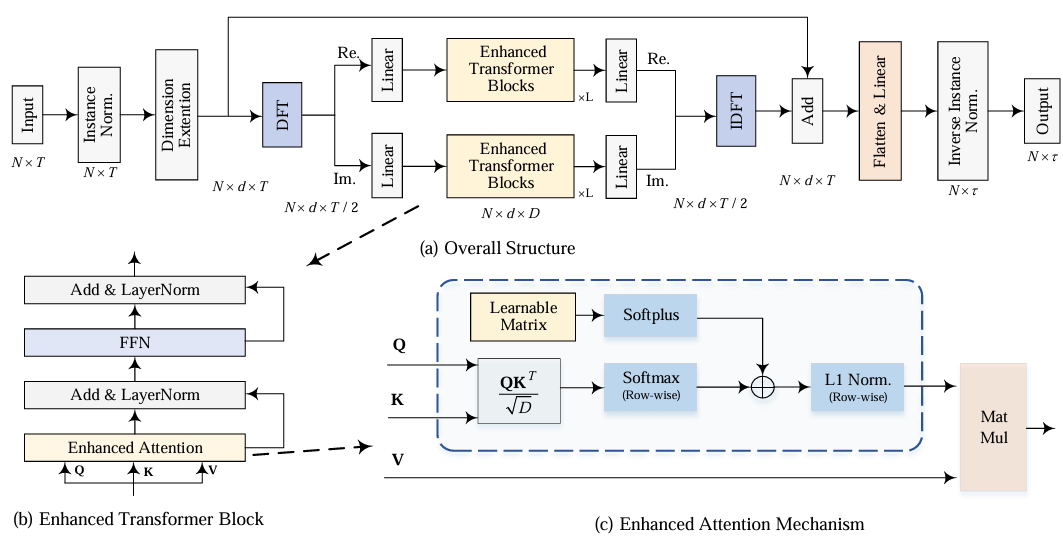

FreEformer: Frequency Enhanced Transformer for Multivariate Time Series Forecasting

方法:论文提出了一种名为FreEformer的时间序列预测模型,它基于Transformer架构,将时间序列数据转换到频域进行建模,并通过增强注意力机制提升特征多样性和梯度流动,从而实现更准确的多变量时间序列预测。

创新点:

将时间序列转换到频域进行建模,利用频谱信息捕捉时间序列的全局特征。 引入增强注意力机制,通过添加可学习矩阵提高注意力矩阵的秩,增强特征多样性。 在多个真实世界数据集上验证了模型的有效性,性能优于现有先进方法。

扫码添加小享,回复“时序融合”

免费获取全部论文+开源代码

扫码添加微信

扫码添加微信

- 点赞 0

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊