POSTER在面部表情识别(FER)中通过其双流金字塔交叉融合设计,有效地结合了面部标志点和图像特征,取得了最先进(SOTA)的性能。然而,POSTER的架构无疑很复杂。具体来说,POSTER的双流设计和金字塔架构涉及大量的参数。此外,POSTER在交叉融合中使用的交叉注意力机制具有平方级的计算复杂度。这些设计导致POSTER的计算成本很高,不利于其在FER中的工业部署。为了解决与POSTER相关的计算挑战,本文介绍了POSTER++。POSTER++简化了POSTER中使用的双流设计,并引入了一种轻量级的多尺度交互(MSI)网络来替代POSTER的金字塔架构。MSI直接通过注意力交互将不同尺度的面部信息整合到标记嵌入中。这使得POSTER++能够将更多的注意力集中在当前面部图像最有用的尺度上的标记嵌入,从而提高判别能力。此外,本文提出了一种基于窗口的线性复杂度交叉注意力机制,作为普通交叉注意力机制的替代方案。与Swin Transformer不同,POSTER++使用基于整个面部标志点特征的单窗口查询与所有面部特征窗口进行交互,有助于更好地捕捉表情的细微变化。与POSTER相比,经过上述改进的POSTER++展示了SOTA的FER性能,同时减少了39.1%的参数、46.4%的FLOPs和64.5%的推理时间。这证明了POSTER++作为FER工业部署骨干网络的潜力。

这篇论文的研究背景是面部表情识别(FER)在人机交互中的重要性,它帮助机器通过面部表情理解人类情感,在心理学、智能机器人、虚拟现实等领域有广泛应用。尽管已有许多FER方法,但现有模型如POSTER虽然性能优越,却因复杂架构和高计算成本难以在工业中部署。因此,研究旨在通过改进POSTER的网络设计,提出更简单高效的POSTER++,以解决参数过多和计算复杂度过高的问题,从而提升FER任务的实际应用潜力。

这篇论文提出了一种改进的面部表情识别(FER)网络POSTER++,通过简化双流设计、引入窗口交叉注意力机制和多尺度交互网络来取代原有的金字塔架构和普通交叉注意力机制。

图1 POSTER管道

回顾POSTER

POSTER是一种在面部表情识别(FER)领域表现卓越的网络架构,通过双流金字塔交叉融合设计有效结合了面部关键点和图像特征,解决了类内差异、类间相似性和尺度敏感性等关键问题。如图1所示,POSTER核心设计包括双流结构、交叉融合机制以及金字塔架构,其中双流结构利用面部关键点特征和图像特征的交互来提升表达能力,金字塔架构则引入多尺度特征以应对不同尺度的挑战。然而,POSTER的复杂架构导致参数量大、计算成本高,限制了其在工业部署中的应用。

图2 POSTER++体系结构概述

简化双流设计

如图2所示,POSTER++对原始POSTER的双流设计进行了简化,移除了图像到关键点分支(image-to-landmark branch),仅保留了关键点到图像分支(landmark-to-image branch)。通过理论分析与实验验证,研究发现关键点到图像分支在解决类内差异和类间相似性问题上起到了核心作用,而图像到关键点分支虽然对性能有一定贡献,但其计算成本较高且效果有限。因此,POSTER++通过移除冗余分支显著减少了参数量,同时保持甚至提升了FER性能。

基于窗口的交叉注意力机制(W-MCSA)

为了降低POSTER中普通交叉注意力机制的平方级计算复杂度,POSTER++提出了一种基于窗口的交叉注意力机制(W-MCSA)。该机制将整体面部关键点特征作为单一窗口查询,与每个窗口的面部特征进行交互,从而捕捉更细致和显著的面部特征。这种设计不仅有效利用了关键点的稀疏性和显著性,还成功将计算复杂度从平方级降至线性级,大幅提升了计算效率,同时更好地解决了类间相似性和类内差异问题。

轻量级多尺度交互网络(MSI)

POSTER++用一种轻量级多尺度交互网络(MSI)替代了POSTER的金字塔架构以解决尺度敏感性问题。MSI直接从不同尺度的面部特征和关键点特征中提取信息,并通过注意力机制动态调整不同尺度的权重。相比金字塔架构,MSI网络提供了更灵活的多尺度特征融合方式,能够根据当前任务需求选择最合适的尺度特征嵌入,从而进一步减少参数量并提升FER性能。实验证明,MSI网络在多尺度特征整合和交互方面表现优异,是POSTER++的核心改进之一。

对比实验

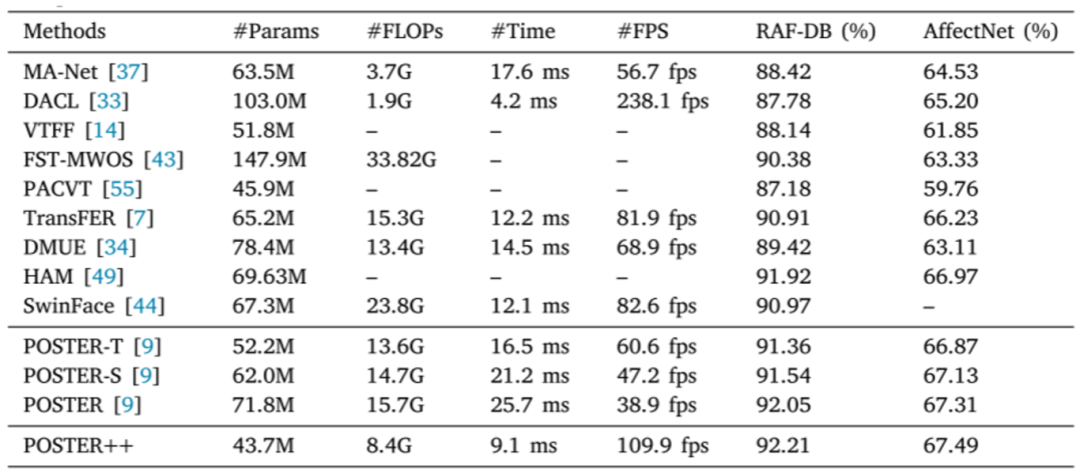

表1 在RAF-DB和AffectNet上与最好的算法的比较结果

表2 POSTER和POSTER++在RAF-DB、AffectNet (7 分类)和AffectNet (8 分类)数据集上的分类准确率。 绿色、蓝色和红色分别为RAF-DB、AffectNet (7 分类)和AffectNet (8 分类)中单个类别的最高值

在RAF-DB数据集上的实验结果如表1所示,本文将POSTER++与近年来最先进的面部表情识别算法进行了对比。实验数据表明,POSTER++在该数据集上展现了最优性能:相比POSTER(92.05%准确率)提升了0.16%,较EAC(90.35%)高出1.86%,比TransFER(90.91%)也有1.3%的优势。表2进一步展示了POSTER++与POSTER在各个表情类别上的准确率对比。虽然POSTER++在多个分类上表现更优,但平均准确率却略低于POSTER。这说明模型在不同情绪类别的识别性能上存在波动——某些类别提升的同时,其他类别可能出现小幅下降,最终导致整体均值微降。这种"此消彼长"的现象在模型优化过程中较为常见,后续可通过类别平衡策略进一步改进。

在AffectNet数据集上的实验结果如表1所示,本文对AffectNet(7分类)和AffectNet(8分类)两个版本都进行了面部表情识别测试。实验结果表明,POSTER++在这两个版本上都取得了当前最先进的识别效果。具体来看,在7分类任务中,POSTER++以67.31%的准确率比POSTER(67.13%)提升了0.18%,同时较TransFER(66.23%)高出1.26%;在8分类任务中,POSTER++达到63.34%的准确率,相比POSTER(62.91%)提升0.43%,比DAN(62.09%)领先1.68%。表2的详细对比显示,POSTER++在大多数单一表情类别上的识别准确率都超过了POSTER,这使得POSTER++在AffectNet数据集上获得了更高的整体平均准确率。这些数据充分证明,即使面对规模更大的数据集,POSTER++依然能够保持出色的表情识别性能。

表3 与最好的算法在CAER-S的比较结果

在CAER-S数据集上的测试结果同样令人瞩目。如表3所示,POSTER++在该数据集上表现极为出色,以92.98%的准确率刷新了当前最优成绩。具体来看:相比前代模型POSTER(92.73%)提升了0.27%,较GLAMOR-Net(89.88%)高出3.12%,比MA-Net(88.42%)领先4.58%,更是大幅超越Efficient-Face(85.87%)达7.13%。这一系列优异的成绩充分证明,POSTER++的成功绝非偶然。CAER-S数据集上的卓越表现,进一步验证了POSTER++在复杂场景下的强大识别能力。

表4 Param、FLOPs、FPS、Inference Time与其他方法的比较

从表4可以看出,POSTER++在参数量(Params)、计算量(FLOPs)和推理时间都更小的情况下,取得了比基线模型更好的表情识别效果。相较于POSTER、TransFER、DMUE和SwinFace等模型,POSTER++在显著提升计算效率的同时进一步提高了系统性能。虽然与MA-Net相比计算量稍大,但POSTER++在实时性和准确率上更具优势。DACL虽然在计算成本和实时性上表现较好,但其分类性能与POSTER++仍存在一定差距。具体来看:与POSTER-T相比,POSTER++减少了850万参数、52亿次浮点运算和7.4毫秒推理时间,同时在RAF-DB和AffectNet数据集上分别提升了0.85%和0.62%的准确率;与POSTER-S相比,参数量减少1830万,计算量降低63亿次,推理时间缩短12.1毫秒,准确率提升0.67%(RAF-DB)和0.36%(AffectNet);与原始POSTER相比,更是减少了2810万参数、73亿次计算和16.6毫秒延迟,同时保持准确率的持续提升。这些对比结果表明,POSTER++在计算成本、实时性和识别性能之间实现了更优的平衡,使其成为工业级表情识别系统部署的更佳选择。

图3 POSTER++交叉融合阶段注意力可视化结果。 每个三元组包括输入图像(左),地标图像(中)和注意图(右)。

本文可视化了POSTER++交叉融合阶段的最高级别特征的注意图。从图3中本文可以看到,POSTER++借助面部地标特征成功捕获了重要的面部表情特征。

本文通过对POSTER的双流设计进行简化,并引入基于窗口的交叉注意力机制和多尺度交互网络(MSI),成功替代了原有的普通交叉注意力机制和金字塔网络,从而克服了POSTER参数量大、计算复杂度高的局限性。基于这些改进,POSTER++在多个标准面部表情识别(FER)数据集上表现出最先进的性能,同时减少了39.1%的参数量、46.4%的浮点运算数(FLOPs)以及64.5%的推理时间。这一系列优化使得POSTER++在准确性与计算效率之间实现了更好的平衡,展现出在工业部署中的巨大潜力。

扫码添加微信

扫码添加微信

扫码添加微信

扫码添加微信

扫码加入群聊

扫码加入群聊