AI的尽头是能源?(1)

- 2025-07-12 08:30:00

想了解大赛详情,请点击下方图片

👇👇

作者简介

本文是第二届电力电子科普征文大赛的获奖作品,来自上海科技大学的诸葛英健投稿。

据《华尔街日报》7月1日报道,亚马逊云服务正与美国最大的核电厂运营商Constellation Energy接近达成一项直接供电协议。而早在今年3月,亚马逊以6.5亿美元收购了位于宾夕法尼亚州的Talen Energy旗下的Cumulus数据中心园区,其由相邻的2.5GW Susquehanna核电站直接供电。

图1. Cumulus数据中心园区

近年来生成式AI掀起热潮,自ChatGPT横空出世,国内外的各种大模型和产品以令人眼花缭乱的速度更新迭代。在ChatGPT不断发展的同时,微软紧随其后,将云服务全线铺开,并将Copilot深度集成到Windows生态中。Google也推出了Bard,并在之后推出了原生多模态大模型Gemini。国内市场,2023年3月,百度正式发布预训练生成式大语言模型“文心一言”。此后,讯飞“星火”、阿里云“通义千问”、腾讯“混元”、华为“盘古”等大模型陆续发布。用户不仅可以与人工智能进行实时对话,还可以让AI协助自己进行资料检索、概括总结等工作,甚至帮自己写代码以及修改论文。

很快地,大模型扩展到了文本应用以外的领域。以Stable Diffusion、Midjourney|、Adobe Firefly等为代表,文生图领域同样突飞猛进。文本生成视频领域同样在快速进化,Sora、Pika、Luma、快手可灵AI等竞争激烈,近几日全面开放的Runway3,更是已经可以生成10s的视频。

随着人工智能的飞速发展,其耗电量也在急剧上升,甚至大量科技公司都在与核电站所有者进行洽谈,那么能源会成为限制其发展的绊脚石吗?

AI为什么耗电

思考是消耗热量的,仅占人体2%重量的大脑却消耗了人体约20%的能量。类似地,人工智能也是很耗能的。根据国际能源署估计,在2022年,数据中心、加密货币、人工智能(AI)消耗了大约460 TWh的电力,几乎占全球总电力需求的2%,而这一数据,预计到2026年将超过1000 TWh[1]。

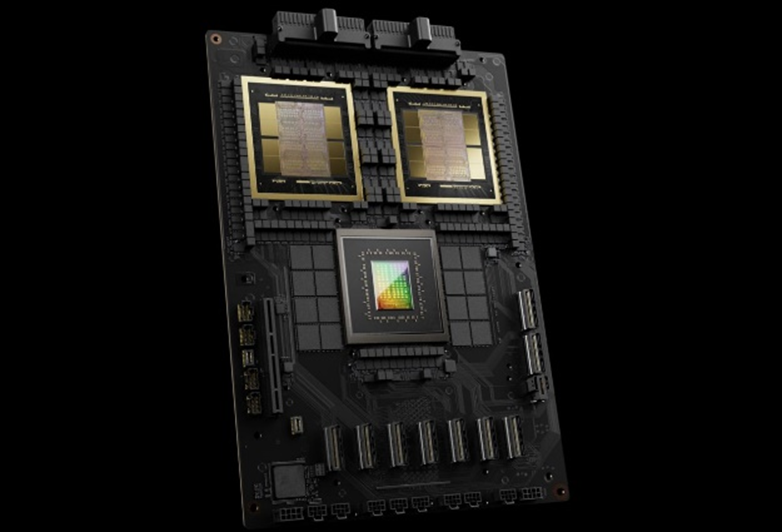

早在2022年,Hugging Face的研究者们就量化了各个大模型的耗电量和碳排放数据。其自家的BLOOM,拥有1760亿参数的大模型,前期训练时长约118天,就花掉了43.3万度电。而参数量与之相当的GPT-3,更是耗电128.7万度,与121个美国家庭一整年的平均耗电量相当[2]。GPT-3训练用到了1024张A100芯片,被称为“千卡千参”,而目前的GPT-4、GPT-5等大模型都达到了“万卡万参”的规模,同时所用芯片也从A100更新到了H100、B200,参数量的激增导致能耗显著增加。有人估算,GPT-4的一次训练中仅GPU就耗电2.4亿度。

图2. Technology advancement | @ TSMC

图3. GB200-Superchip | @ NVIDIA

另一方面,大模型的训练过程甚至会导致局部电网的崩溃。Kyle Corbitt在今年3月曾发表消息称,训练GPT-6的微软工程师们正在搭建Infiniband网络,把不同地区的GPU连接起来,如果将这10万块H100芯片部署在同一地区,电网则会崩溃。

图4. tweets内容 | @ X @corbtt

但人工智能的高能耗不仅仅体现在前期训练过程中,更是在后期使用过程中的累积。

前期的训练过程就是反复调整模型参数,直到模型的性能不再显著提高为止,这一阶段是有限度的。而推理阶段则大大不同,我们每向大模型问一次问题,都是一次推理请求。

图5. ChatGPT | @ OpenAI

我们每一次在搜索栏键入内容。或者点开新视频等操作,终端设备都会与某个数据中心发生信息交换,而这一些操作都需要消耗能量。Alphabet董事长John Hennessy在2023年2月指出,一次标准的Google搜索平均耗电0.3 Wh,而如果采用大模型的话,平均每次搜索的能耗将提高近10倍,即3 Wh每次。此外,根据SemiAnalysis机构的预测,谷歌要实现搜索全面人工智能化,需要512821个英伟达A100 HGX服务器,共4102568块GPU。以每个服务器6.5 kW的功率来计算,这些服务器每天的耗电量就将高达80 GWh,年耗电量29.2 TWh。根据谷歌报道,从2019年至2021年,其60%的AI相关能耗都来自推理[3]。

长远来看,AI推理过程的耗能将越来越大;短期内,AI训练的能耗是能耗的主要增量。

未完待续…

敬请期待下期精彩~

参考资料

[1] “Electricity 2024 – Analysis and forecast to 2026”. International Energy Agency, Jan. 2024.

[2] Luccioni, Alexandra Sasha, Sylvain Viguier, and Anne-Laure Ligozat. "Estimating the carbon footprint of bloom, a 176b parameter language model." Journal of Machine Learning Research 24.253 (2023): 1-15.

[3] de Vries, Alex. "The growing energy footprint of artificial intelligence." Joule 7.10 (2023): 2191-2194.

[4] “Google Environmental Report 2024”, Google, Jul. 2024.

[5] “The AI Index 2024 Annual Report,” AI Index Steering Committee, Institute for Human-Centered AI, Stanford University, Stanford, CA, April 2024.

更多精彩内容

中国电源学会第三届

电力电子科普作品创作大赛

现已开启征稿,

扫描下方二维码,即可报名!

👇👇

欢迎点击卡片

关注电子电力工程师园地

扫码添加微信

扫码添加微信

- 点赞 0

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊