Diffusion/VAE/RL 数学原理

- 2025-07-25 08:00:00

作者 | Haodong Li 编辑 | 大模型之心Tech

原文链接:https://zhuanlan.zhihu.com/p/1925164899094487839

点击下方卡片,关注“大模型之心Tech”公众号

>>点击进入→大模型没那么大Tech技术交流群

本文只做学术分享,如有侵权,联系删文,自动驾驶课程学习与技术交流群事宜,也欢迎添加小助理微信AIDriver004做进一步咨询

最近做的两个project,一个训VAE,一个训RL都进行project尾声了,但是对于数学原理上的掌握还很浅

看到了这个up的slide做的非常不错,在这里结合自己的理解分享一下

【大白话01】一文理清 Diffusion Model 扩散模型 | 原理图解+公式推导_哔哩哔哩_bilibili

Diffusion

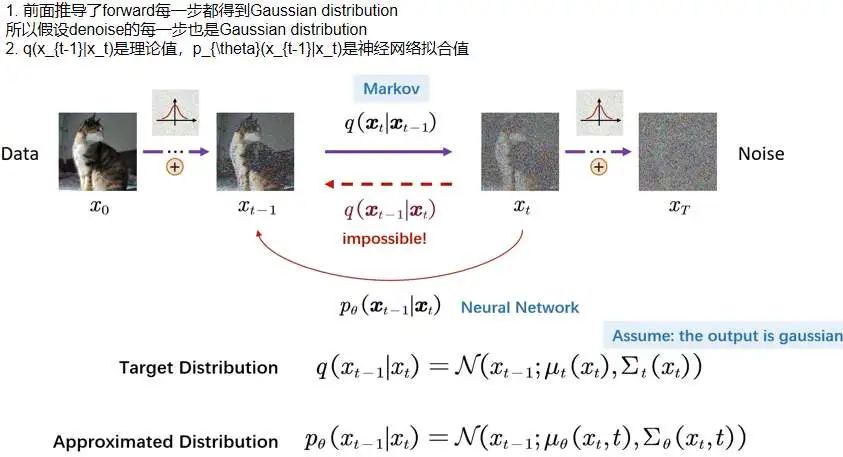

原图提供gaussian distribution的mean value,noise系数提供Gaussian distribution的variance value

!$\sqrt{\alpha_t-\alpha_t\alpha_{t-1}}\epsilon_{t-2}\sim N(0,\alpha_t-\alpha_t\alpha_{t-1}) \\ \sqrt{1- \alpha_t}\epsilon_{t-1}\sim N(0,1- \alpha_t) \\ \sqrt{1- \alpha_t}\epsilon_{t-1}+\sqrt{\alpha_t-\alpha_t\alpha_{t-1}}\epsilon_{t-2}\sim N(0,1-\alpha_t\alpha_{t-1}) $

假设每一步denoise都满足gaussian distribution,所以network训练目标是拟合这两个gaussian distribution的mean&variance

先忽略推导,只关注KL项

中间这个KL项就是在拟合denoise中理论值和network预测值

虽然 !$q(x_{t-1}|x_t)$ 是不确定的,但是 !$q(x_{t-1}|x_t,x_0)$ 是个确定的过程

这里的推导比较复杂,化简的结果就是 !$x_0$ 是未知的

将本来不确定的 !$x_0$ 转为不确定的 !$\epsilon$ ,迭代预测noise

最后这里就没啥好说的了,将拟合两个distribution转为拟合两个noise

VAE

VAE假设latent distribution是个gaussian distribution

AE是没有生成能力的

用神经网络拟合encoder

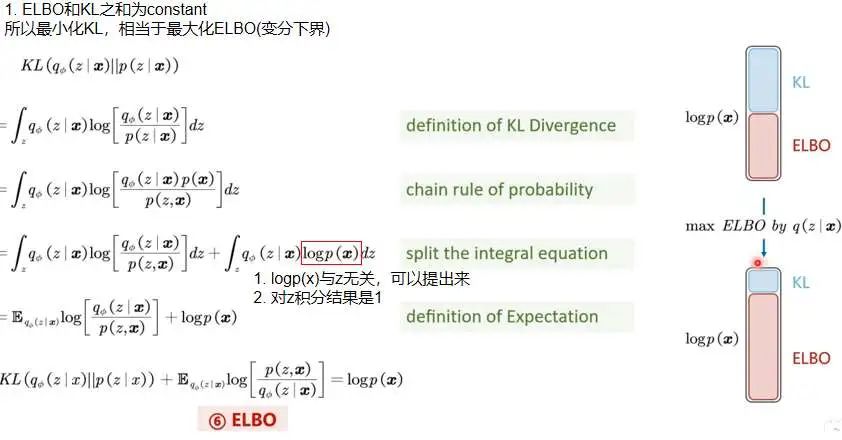

最小化KL loss,相当于要最大化ELBO

logp(x)相当于是在原始数据集的分布,是确定的

为了避免latent space退化为variance=0的尖锐分布,无法学出gaussian distribution

通过假设p(z|x)即encode处满足gaussian distribution

将VAE的训练转为重建loss+KL约束loss

training&sampling

reconstruction loss & kl loss的PCA消融实验

补充一下表征这件事情

semantic representation:希望它趋近于脉冲分布 generate representation:希望它趋近于Gaussian分布

原因:希望对generate representation进行插值,但是semantic representation希望它进行classification

RL

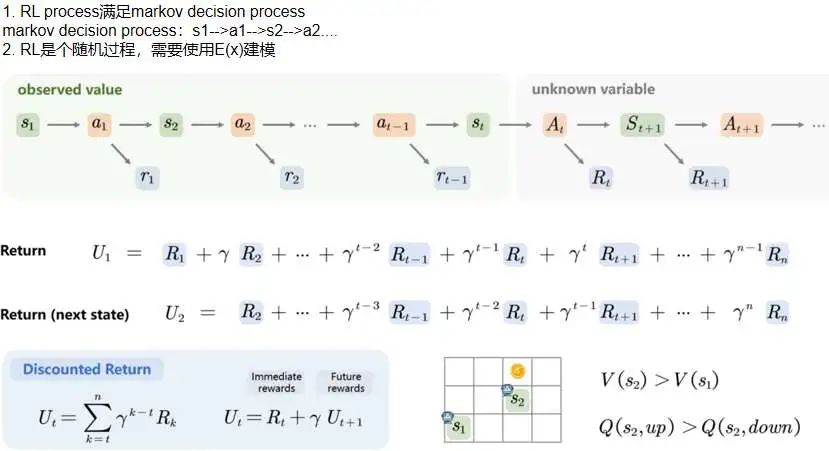

markov decision process就是(s1,a1,s2,a2...)

结合马尔可夫的图,分清楚在哪个点上是action value,哪个点上是state value

temporal difference:往前多走一步,用更准确的结果更新过去的估计

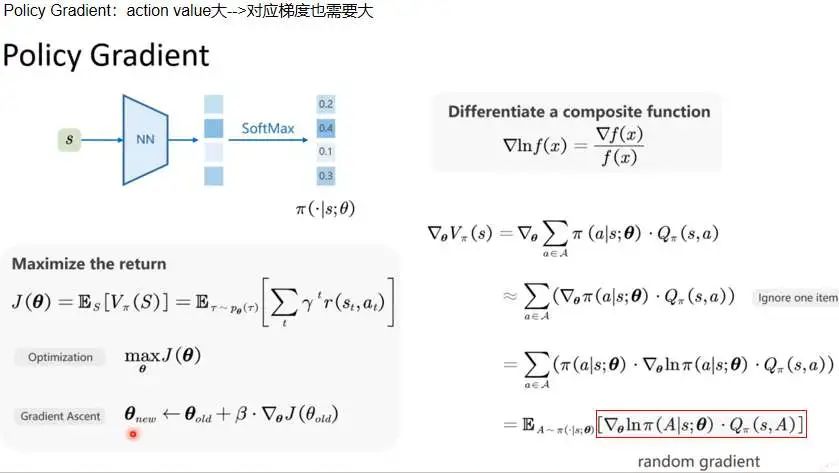

policy gradient:让network去学习怎么样在知道s的情况下,s-->a可以取到最合适的转换

大模型之心Tech知识星球交流社区

我们创建了一个全新的学习社区 —— “大模型之心Tech”知识星球,希望能够帮你把复杂的东西拆开,揉碎,整合,帮你快速打通从0到1的技术路径。

星球内容包含:每日大模型相关论文/技术报告更新、分类汇总(开源repo、大模型预训练、后训练、知识蒸馏、量化、推理模型、MoE、强化学习、RAG、提示工程等多个版块)、科研/办公助手、AI创作工具/产品测评、升学&求职&岗位推荐,等等。

星球成员平均每天花费不到0.3元,加入后3天内不满意可随时退款,欢迎扫码加入一起学习一起卷!

扫码添加微信

扫码添加微信

- 点赞 (0)

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊