带你吃透一条产业链:AI 算力产业(爆发)

- 2025-07-23 11:30:00

01 产业链全景图

基于AIGC的技术栈,算力层作为上层模型及应用的重要支撑

AI算力如同引擎的燃料,是驱动人工智能系统运行的关键要素。模型性能的优劣与响应速度,本质上都依赖于算力的支撑。

在模型训练阶段,算力承担着关键作用。它需要解析庞大的数据集,优化数以亿计的模型参数。通过从无序信息中挖掘规律,使模型掌握语言理解和内容生成能力,这一过程完全依赖算力的持续供给。数据复杂度越高,所需的计算资源就越密集。

我们日常接触的AI应用,其背后都有强大的算力在支撑。语音助手能即时响应指令,得益于算力在极短时间内完成海量语音特征的比对;人脸识别支付系统的快速验证,则是算力高效处理生物特征数据的结果,其运算速度直接决定了用户体验的流畅程度。

算力不足会导致AI系统表现失常。实际应用中,计算资源匮乏会造成翻译延迟、图像识别错误等问题,严重影响功能使用效果。

当前AI领域的竞争,本质上就是计算资源的比拼。算力储备越雄厚、使用效率越高,就越能加速开发出更先进的模型。正如电力革命催生了家用电器普及,算力的快速发展正推动AI技术从实验室走向手机终端、工业生产等各个领域,成为触手可及的工具。

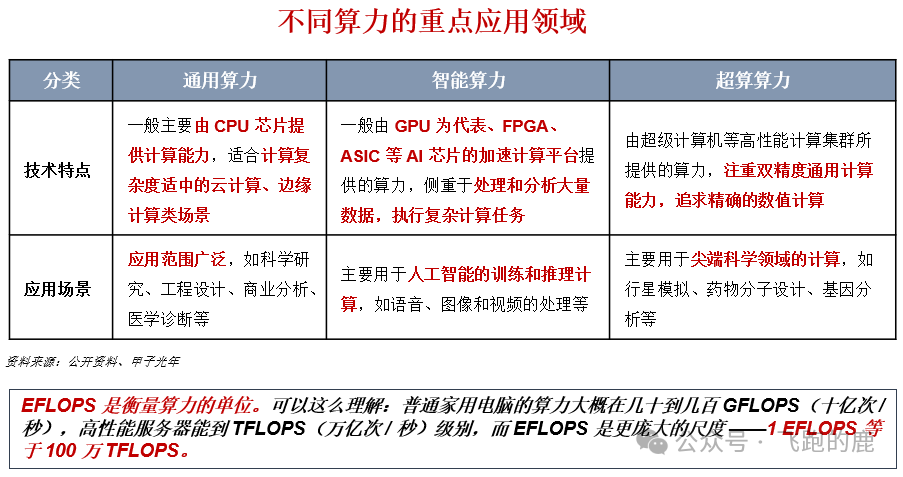

算力类型划分

全球计算资源主要分为通用计算、智能计算和超级计算三大类。通用计算如同"万能工具",负责处理云计算、日常办公等基础运算任务;智能计算则扮演"专业顾问"角色,专注于人工智能、图像处理等新兴领域的复杂运算;超级计算则是"科研利器",专攻气象预测、基因测序等高精尖领域的计算需求。

03 上游产业链

03-1、AI 芯片

AI芯片作为计算领域的"专用动力核心",被业界称为AI加速器或运算单元,其核心使命是高效执行人工智能所需的复杂运算——相当于为AI系统配备了一台特制的高性能运算设备,专门攻克其特有的计算挑战。

市场表现最能说明问题:全球AI芯片市场规模在2023年达到536亿美元后,预计2024年将激增至710亿美元,年增长率突破30%;到2025年,尽管增速可能略有放缓,但市场规模仍将扩张至920亿美元。这一增长态势直接反映了AI技术的全球性爆发——海量数据处理如同AI的"营养供给",智能运算则推动AI"加速进化",而AI芯片正是支撑这一切的"核心动力源"。需求越旺盛,技术发展越迅猛,芯片市场的扩张也就越显著。

AI 芯片市场像块「算力蛋糕」。2022 年,英伟达几乎把蛋糕攥在手里 —— 国内 107 万张加速芯片里,它啃走 85%,相当于十块里吞掉八块半;国产芯片只能分零头:华为昇腾拿 10%,百度分 2%,寒武纪和燧原只有区区1% 。

到 2024 年,蛋糕变大了(超 270 万张出货),国产终于抢到三成(82 万张)。但对比英伟达当年的垄断级占比,国产芯片仍是「追着跑的选手」,虽在加速追赶,距离行业龙头的统治力还远 。

AI 芯片分为 GPGPU、FPGA 和 ASIC 三大阵营,国产芯片厂商以 GPGPU 和 ASIC 阵营为主。具体区别如下:

近 10 年来国产 AI 芯片厂商快速涌现,同时互联网大厂均开始推出自研 AI 芯片以满足自身业务需求。具体如下:

03-2、AI 服务器

AI服务器堪称人工智能的"超级演算中心",是专为AI运算任务打造的高性能平台。与常规服务器最大的区别在于其搭载了多颗AI专用处理器——包括GPU、华为昇腾等为AI深度优化的计算芯片,具备惊人的运算能力。

这类服务器主要承担两大核心职能:首先是模型训练,通过处理PB级数据并优化数十亿参数,使AI掌握语言理解、图像识别等智能;其次是实时推理,支撑语音交互即时响应、人脸识别毫秒级验证等高并发场景的流畅运行。

当下热门的ChatGPT对话系统、自动驾驶视觉处理等AI应用,其运行都高度依赖这类服务器集群的支持,它们构成了AI系统展现智能的"数字基座"。

图示:华为自研 AI服务器

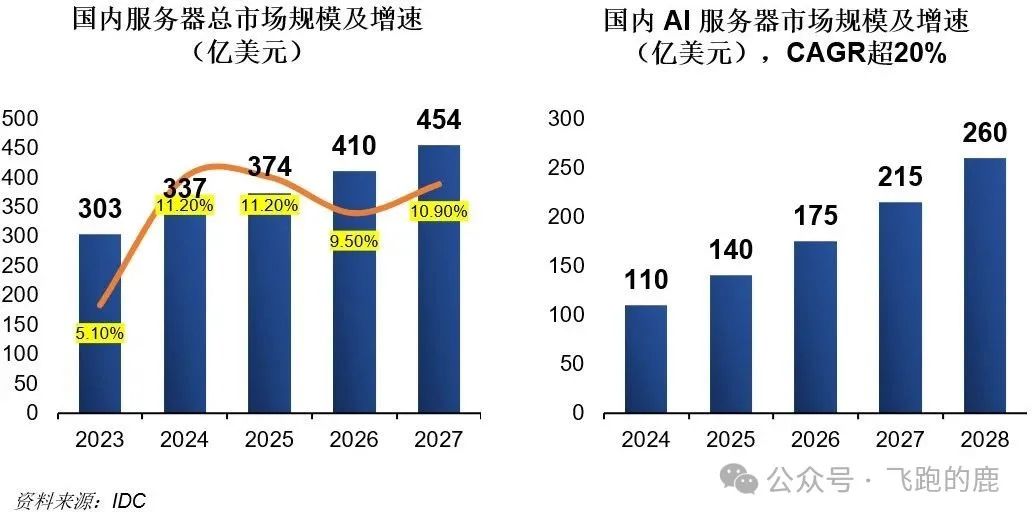

当前互联网、通信服务和金融三大核心领域正持续为AI算力注入强劲动能,推动国内AI服务器市场进入高速扩张通道。根据IDC行业分析,未来四年服务器市场规模将保持年均10%的平稳增长,而AI服务器则以显著优势领跑市场扩张曲线,持续拉开与传统通用服务器的身位差距。

在AI服务器领域,GPU服务器仍占据绝对主导地位——其43亿美元的市场体量独占86%的份额;与此同时,基于NPU、ASIC及FPGA架构的非GPU加速服务器正呈现爆发式增长,同比增速高达182%,整体规模已攀升至7亿美元量级。

放到全球看,大型云服务商和企业都在给 AI 算力 “加预算”,全球 AI 服务器市场跟着加速跑,规模正一步步拉近和通用服务器的距离。

04 中游产业链

04-1、智算中心

随着人工智能技术的突飞猛进,人类社会正加速迈入智能时代,由此带来的算力需求呈现指数级增长。传统数据中心以CPU为核心的计算架构,在处理常规业务时表现尚可,但面对AI所需的大规模并行计算任务时则显得力不从心。在此背景下,专门为AI训练和推理提供强大计算支持的智算中心应运而生,犹如为人工智能量身打造的"超级动力站"。

当前,我国智能算力发展已实现历史性跨越,不仅超越通用算力规模,更成为推动整体算力增长的核心动力。自2022年以来,智能算力在总算力中的占比持续扩大,其主导地位日益凸显。

据中国信息通信研究院预测,未来五年全球算力规模将保持50%以上的年增长率;而我国智能算力发展更为迅猛,从2022年的259.9EFLOPS(FP16精度)预计增长至2027年的1117.4EFLOPS,年均复合增长率高达33.9%。

智算中心建设也在加速,2024 年上半年,全国建好和在建的已经超 250 个,招投标搞了 791 次,超 20 个城市都有了自己的智算中心,扎堆落地。

现在的智算中心建设运营模式分好几类:政府直接投资建设、企业自己建了自己运营、政府花钱买现成服务、政府和社会资本合伙干,就像盖大楼,有的自己出钱盖,有的请人盖了代管,有的直接租现成的,有的合伙出钱盖了分收益。主要产业合作方如下:

04-2、云计算

云计算是按用量收费的模式,好比 “算力水电”—— 想用多少就用多少,按实际用的算钱。它把网络、服务器、存储、软件这些资源打成一个共享池,随时能调出来用,不用自己费心管理,也不用老跟服务商打交道,点一下就到位。

核心是云服务厂商,国内外主要玩家有亚马逊、微软、谷歌、Facebook、苹果,还有阿里、腾讯这些转型的互联网公司,他们管着弹性计算、网络、存储、应用这些 “算力供给”。

05 下游产业链-应用场景

05-1、AI智驾

2025年,智能驾驶技术正经历着类似智能手机的普及历程——功能持续迭代升级的同时,价格却不断下探。曾经仅限高端车型的先进智驾功能,如今已逐步渗透至主流消费市场,从少数用户的尝鲜配置转变为大众化的标准配置,成为各大车企竞相争夺的战略高地。

市场数据印证了这一趋势:自2022年以来,具备L2级及以上自动驾驶功能的新车占比持续攀升。截至2024年11月,在每百辆新售车型中,配备高速NOA(L2.5级)功能的达3.5辆,而搭载城市NOA(L2.9级)功能的更高达10.1辆。

当前智能驾驶市场已形成明显的差异化竞争格局:在20万元以上的高端市场,车企聚焦于打造"全场景智能驾驶"能力,竞相提升端到端的路况处理能力和世界模型的智能化水平,致力于提供极致的驾驶体验;而在中低端市场,各品牌则着力推动智驾功能的平价化,以最具性价比的方案实现核心功能的实用化落地。

按这趋势,2025 年高速 NOA(只带高速功能,没城市版)和城市 NOA 的装车率会跳一大截 —— 每 100 辆车,预计 16 辆装高速 NOA,14 辆带城市 NOA(Navigate on Autopilot,通常被业界称为“领航辅助驾驶”或“高阶智能驾驶”)。

05-2、AI + 医疗

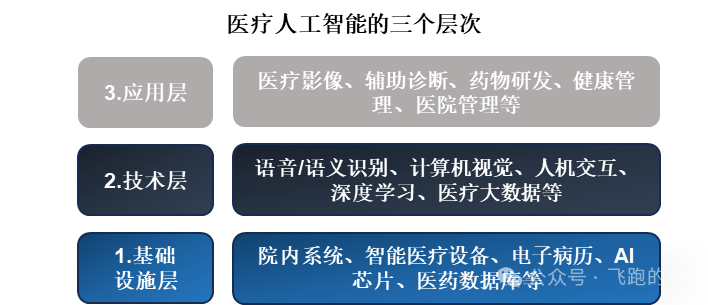

人工智能闯进医疗行业,要彻底改写游戏规则 —— 通过技术创新重构医院的运作链条,让效率提上去,还能催生出新的市场空间,给传统医疗装了新引擎。

现在看病需求端,老人变多、大家更惜命,想看病的人越来越多;供给端,医生和医院不够用,好资源还扎堆在大城市,供需缺口越拉越大。这种矛盾推着 AI 医疗往前跑,相当于加开列车、优化售票系统。

AI 在医疗里的活儿很杂:看片子(医疗影像)是最熟的领域,像给医生配了超级放大镜;手术机器人在辅助诊断里特别活跃,像精准的下手;算法和算力让找新药方(新药研发)快了好几倍;健康管理领域更是到处能见到它,像随身带的健康管家。

05-3、AI + 金融

金融机构像个 “数据堡垒”—— 信息安全防护得严,数据处理量像堆成山,信息设备铺得全。

这些特点让人工智能技术早早就在金融领域扎了根:营销时能精准找客户,合规上能自动查漏洞,风控环节能提前揪风险…… 就像给金融系统装了智能管家,从多个场景铺开应用,还越做越扎实。

05-4、AI + 物流

声明:文章部分素材来源于公众号:飞跑的鹿,版权归原作者所有。如有侵权,请联系删除。

扫码添加微信

扫码添加微信

- 点赞 (0)

-

分享

微信扫一扫

-

加入群聊

扫码加入群聊

扫码加入群聊